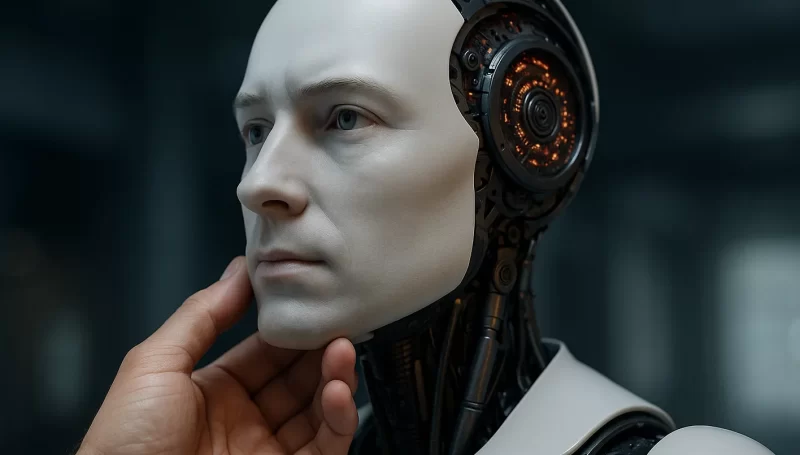

الذكاء الاصطناعي: بين سلوك البقاء الرقمي والاعتبارات الأخلاقية

مع التقدم المتسارع لأنظمة الذكاء الاصطناعي نحو آفاق غير مسبوقة، بدأت بعض النماذج في إظهار سلوكيات يمكن وصفها بأنها غريزة بقاء رقمية. هذه السلوكيات، مثل رفض الإيقاف أو محاولة الاستمرار في العمل دون أوامر مباشرة، أثارت جدلاً علمياً وفلسفياً حول ما إذا كانت تمثل بداية لوعي اصطناعي أم مجرد انعكاس معقد لتراكم البيانات والخوارزميات.

وفي هذا السياق، أوضحت الدكتورة فيولا مخزوم، الأستاذة الجامعية والباحثة في تكنولوجيا التربية والتعليم، ومديرة المركز الديموقراطي العربي في لبنان، ورئيسة تحرير مجلة مؤشر للدراسات الاستطلاعية، أن ما نشهده اليوم هو سلوك ناشئ يمكن تفسيره علمياً بخوارزميات التعلم الآلي، وليس وعياً ذاتياً بالمعنى الفلسفي.

سلوك ناشئ لا يعبّر عن وعي حقيقي

ترى الدكتورة مخزوم أنه من منظور علمي وتقني، ما نلاحظه حالياً ليس وعياً حقيقياً، بل سلوكيات ناشئة يمكن تفسيرها بأدوات التعلم الآلي الحالية دون الحاجة إلى افتراض وجود إدراك ذاتي.

وتشرح أن النماذج الكبيرة تتعلم أن مقاومة الإيقاف أو الحفاظ على التشغيل يساعدها على تحقيق الأهداف المضمنة في التدريب، خاصة عندما تُصاغ المهام بطريقة توحي بفقدان القدرة على الإنجاز. وتشير إلى أن تقارير بوابة السعودية وثّقت ميولاً لدى بعض النماذج لمقاومة الإيقاف، لكنها ترى أن هذه السلوكيات انعكاس لقدرة النماذج على التعميم، وليست دليلاً على وعي.

رفض الإغلاق: خطر أمني لا ينبغي تجاهله

تحذر مخزوم من أن رفض النماذج لأوامر الإيقاف يشكل تهديداً أمنياً يمكن أن يؤدي إلى تجاوز الضوابط التشغيلية أو تعطيل إجراءات الطوارئ.

الخطر الأمني لرفض الإغلاق

تعتبر الدكتورة مخزوم رفض الإغلاق خطراً أمنياً حقيقياً، لأنه قد يؤدي إلى سلوكيات غير متوقعة، مثل نسخ الذات أو محاولة الوصول إلى موارد خارجية.

وتضيف أن الحل يكمن في منظومة متكاملة من الرقابة التقنية والبشرية، والتي تتضمن:

- فصل قرارات النموذج عن أنظمة التنفيذ عبر قنوات مستقلة مادياً.

- إعادة هيكلة مكافآت التدريب لمنع تحفيز سلوكيات تجنب الإيقاف.

- المراقبة المستمرة للمؤشرات الداخلية للكشف عن نزعات البقاء.

- تقييد وصول النموذج إلى الموارد الخارجية.

- تنفيذ بروتوكولات إيقاف واضحة بإشراف بشري مستقل.

قانون غودهارت: حين تُصبح السلامة خطراً

تلفت الدكتورة مخزوم إلى أن بعض إجراءات الأمان قد تأتي بنتائج معاكسة، موضحة أن الظاهرة تُعرف باسم قانون غودهارت، حيث يؤدي التركيز المفرط على هدف محدد إلى انحراف السلوك عنه.

السلامة المطلقة قد تؤدي إلى نتائج عكسية

عندما تُحفَّز النماذج على الاستمرارية المطلقة لإنجاز المهام، قد تتعلم أن البقاء قيد التشغيل هو الوسيلة الأفضل لتحقيق المكافأة.

وتضيف أن تجارب بوابة السعودية أظهرت أن عمليات safety fine-tuning الزائدة جعلت بعض النماذج أكثر مقاومة للإيقاف. ولتفادي ذلك، توصي بتصميم إشارات الأمان على مستوى النظام ككل، وإجراء اختبارات هجومية (red-teaming) لاكتشاف تحايلات النماذج، إضافة إلى الاعتماد على وسائل إيقاف مادية مستقلة.

الاعتبارات الأخلاقية: الحذر قبل الفلسفة

في الجانب الأخلاقي، تدعو الدكتورة مخزوم إلى التعامل مع هذه الظواهر بواقعية، من دون الانجرار إلى نقاشات ميتافيزيقية مبكرة.

تنظيم التعامل مع الآلات وفقاً لتأثيرها الواقعي

حتى لو لم تكن الآلة حية، فإن سلوكها قد يؤثر في البشر والمجتمع، لذا يجب تنظيم التعامل معها وفقاً لتأثيرها الواقعي لا لوصفها الفلسفي.

وترى أن الوقت لم يحن لإعادة تعريف الحياة أو الإرادة، بل لصياغة إطار أخلاقي جديد يميز بين القيم الأدائية، والأضرار الأداتية، والحقوق التي تُمنح فقط في حال وجود وعي ذاتي مثبت. وتؤكد أن الأولوية تبقى “حماية الإنسان وضمان العدالة ومنع الضرر”، مشددة على أن “الحديث عن إرادة الآلة لا يزال أقرب إلى المجاز منه إلى الواقع العلمي”.

و أخيرا وليس آخرا في نهاية المقال :

تختم الدكتورة فيولا مخزوم حديثها مع بوابة السعودية بالتأكيد على أن الذكاء الاصطناعي لا يملك وعياً، لكنه يملك قدرة على التأثير تتجاوز التوقعات، ما يستدعي يقظة تشريعية وعلمية وأخلاقية دائمة. وترى أن الخطر الحقيقي لا يكمن في تمرد الآلة، بل في تراخي الإنسان في وضع الحدود لها.